基于机器视觉的端到端AI检测解决方案,专为AI篡改设计

源代码

https://www.gitpp.com/detech/projects06016058801

这是一个市场巨大的项目,通过技术研发、产品化部署、市场推广和生态建设,该项目有望在新闻、司法、金融等领域发挥重要作用,成为AI时代伪造检测的重要工具。

一款基于深度学习(Deep Learning)与计算机视觉(CV)技术的端到端图像伪造检测解决方案,专注于识别和定位图像中的各类篡改痕迹,包括但不限于:

- Deepfake

(换脸、表情操纵) - AI生成内容

(如Stable Diffusion、Midjourney生成的图像) - 拼接操作

(不同图像的组合) - 复制-移动篡改

(同一图像内区域的复制粘贴)

系统基于 PyTorch 框架开发,集成了从数据处理、模型训练到部署的全流程工具链,支持高精度、高效率的篡改检测,适用于对图像真实性要求严格的场景。

使用的技术

- 深度学习:利用 EfficientNet、ResNet 和 Xception 等模型。

- 计算机视觉:实现图像分析技术。

- PyTorch:模型训练和推理的主要框架。

- Flask:用于部署应用程序的轻量级Web框架。

- 机器学习:各种算法增强检测能力。

AI造假 危害巨大

AI造假图片的危害场景简述

AI生成的伪造图片(如Deepfake、AI绘画篡改等)因其高度逼真且易于传播,已在多个领域引发严重危害。以下是几个典型场景:

1. 新闻与舆论操控

- 场景

:不法分子利用AI生成虚假新闻图片(如伪造灾难现场、政治人物言论),通过社交媒体快速传播,误导公众认知。 - 危害

: -

引发社会恐慌(如伪造自然灾害图片)。 -

操纵舆论导向(如伪造政治人物不当言论)。 -

损害媒体公信力,加剧信息信任危机。 - 案例

: -

2023年某国大选期间,Deepfake伪造候选人演讲视频,导致选民情绪波动。

2. 司法与证据欺诈

- 场景

:在司法案件中,伪造图片被用作关键证据(如伪造合同签名、事故现场照片)。 - 危害

: -

干扰司法公正,导致冤假错案。 -

增加司法成本(需额外技术手段验证证据真实性)。 - 案例

: -

某保险理赔案件中,投保人使用AI生成的“事故现场”图片骗取高额赔偿。

3. 金融与商业欺诈

- 场景

:伪造商业文件(如财务报表、合同)或身份信息(如伪造证件照),用于诈骗或非法交易。 - 危害

: -

企业经济损失(如虚假合同导致资金流失)。 -

破坏市场信任,阻碍正常商业活动。 - 案例

: -

某公司利用AI伪造财务数据,吸引投资者注资后卷款跑路。

4. 社交网络与身份冒用

- 场景

:AI生成虚假人像(如Deepfake换脸)用于社交平台注册,实施诈骗或传播色情内容。 - 危害

: -

个人隐私泄露(如伪造身份窃取他人信息)。 -

传播非法内容(如伪造色情视频),侵犯他人名誉权。 - 案例

: -

某社交平台出现大量AI生成的“名人换脸”色情视频,引发法律诉讼。

5. 学术与科研诚信

- 场景

:伪造实验数据图片(如显微镜图像、实验结果图),用于学术发表或项目申报。 - 危害

: -

学术不端行为,破坏科研生态。 -

误导研究方向,浪费科研资源。 - 案例

: -

某科研团队因伪造实验数据图片被撤稿,声誉受损。

6. 政治与国家安全

- 场景

:伪造领导人图像或军事机密图片,用于间谍活动或舆论战。 - 危害

: -

威胁国家安全(如伪造军事部署图)。 -

引发国际关系紧张(如伪造领导人不当言论)。 - 案例

: -

某国情报机构利用Deepfake伪造他国领导人演讲视频,制造外交冲突。

总结

AI造假图片的危害已渗透到社会、经济、政治等多个层面,其核心问题在于“以假乱真”的特性破坏了信息真实性基础。应对这一挑战,需从技术(如AI检测工具)、政策(如立法规范)和公众意识(如教育普及)三方面综合施策。

基于机器视觉的端到端AI检测解决方案(专注于图像伪造检测)

项目地址:https://www.gitpp.com/detech/projects06016058801

项目概述

该项目是一款基于深度学习(Deep Learning)与计算机视觉(CV)技术的端到端图像伪造检测解决方案,专注于识别和定位图像中的各类篡改痕迹,包括:

- Deepfake

(换脸、表情操纵) - AI生成内容

(如Stable Diffusion、Midjourney生成的图像) - 拼接操作

(不同图像的组合) - 复制-移动篡改

(同一图像内区域的复制粘贴)

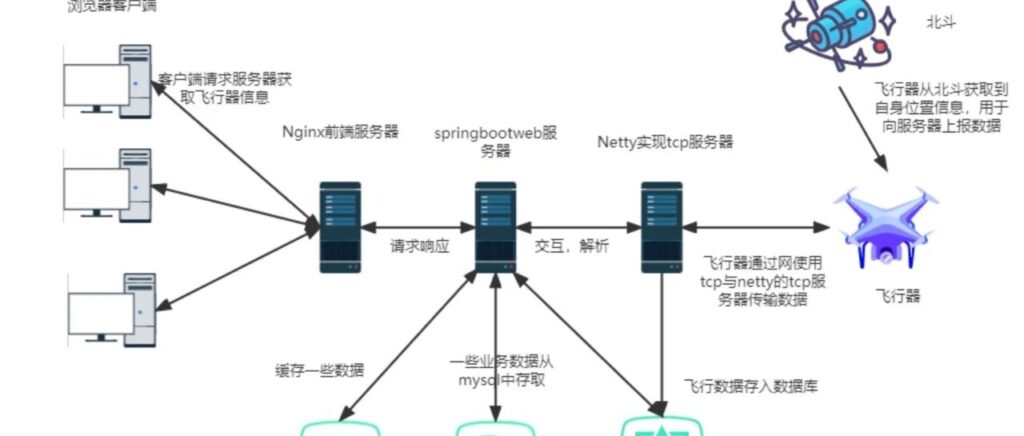

技术架构

- 深度学习

:利用EfficientNet、ResNet和Xception等模型,实现高精度篡改检测。 - 计算机视觉

:通过图像分析技术提取关键特征,辅助篡改定位。 - PyTorch

:作为模型训练和推理的主要框架,支持高效计算。 - Flask

:用于部署应用程序的轻量级Web框架,提供API接口。 - 机器学习

:结合多种算法增强检测能力,适应复杂场景。

核心功能

- 多模态篡改检测

:覆盖Deepfake、AI生成内容、拼接和复制-移动篡改。 - 高精度定位

:输出篡改区域的热力图,直观展示可疑区域。 - 端到端工具链

:集成数据处理、模型训练和部署,支持全流程自动化。 - 实时检测

:通过GPU加速,实现单张图像处理时间<1秒。

市场价值

- AI造假危害加剧需求

-

随着Deepfake和AI生成内容的普及,伪造图像和视频对新闻、司法、金融等领域构成严重威胁。 -

例如,不法分子利用AI换脸技术生成恶搞或色情视频,形成地下黑灰产业链,亟需技术手段进行遏制。 - 政策与监管推动

-

各国政府和平台加强对AI生成内容的监管,推动伪造检测技术的市场需求。 -

例如,社交媒体平台需自动标记疑似伪造图像,避免虚假信息传播。 - 商业价值显著

- 新闻与媒体

:验证新闻图片真实性,维护媒体公信力。 - 司法与取证

:辅助司法机关识别电子证据中的篡改痕迹。 - 金融与保险

:防止保险理赔中的欺诈行为。 - 社交网络

:识别Deepfake视频或AI生成的人像,防止虚假身份传播。

应用场景

- 新闻与媒体行业

-

检测虚假新闻中的伪造图片,确保内容真实性。 -

示例:社交媒体平台可集成该解决方案,自动标记用户上传的疑似伪造图像。 - 司法与取证

-

辅助司法机关识别电子证据中的篡改痕迹,如合同、监控截图。 -

示例:法庭中用于验证关键证据的真实性,防止伪造图像误导审判。 - 金融与保险

-

防止保险理赔中的欺诈行为,如伪造事故现场照片。 -

示例:保险公司可快速筛查客户提交的理赔材料,降低风险。 - 社交网络与内容审核

-

识别Deepfake视频或AI生成的人像,防止虚假身份传播。 -

示例:约会平台可检测用户头像是否为AI生成,避免欺诈行为。 - 教育与科研

-

辅助研究人员分析AI生成内容的传播规律,或验证实验数据的真实性。 -

示例:学术期刊可使用该系统筛查投稿论文中的伪造图像。

市场研发与应用策略

- 技术研发方向

- 模型优化

:持续优化EfficientNet、ResNet和Xception等模型,提升检测精度和效率。 - 抗干扰能力

:增强模型对JPEG压缩、模糊、裁剪等后处理操作的鲁棒性。 - 多模态融合

:结合音频、视频等多模态数据,提升复杂场景下的检测能力。 - 产品化与部署

- API与SDK

:提供轻量级API和SDK,支持快速集成到现有系统。 - 云端服务

:推出云端部署方案,降低用户使用门槛。 - 定制化服务

:针对特定行业(如司法、金融)提供定制化解决方案。 - 市场推广与合作

- 行业合作

:与新闻媒体、司法机构、金融机构等合作,推广解决方案。 - 开源社区

:通过开源社区吸引开发者,完善生态系统。 - 政策倡导

:参与制定AI生成内容检测的行业标准,推动政策落地。 - 生态建设

- 数据集建设

:构建大规模伪造图像数据集,支持模型训练和评估。 - 开发者工具

:提供可视化工具和调试接口,降低开发难度。 - 用户培训

:开展技术培训和研讨会,提升用户使用能力。

总结

该项目通过深度学习与计算机视觉技术的结合,为图像伪造检测提供了高效、可靠的解决方案。其市场价值体现在应对AI造假危害、满足政策监管需求以及商业应用的广泛性。通过技术研发、产品化部署、市场推广和生态建设,该项目有望在新闻、司法、金融等领域发挥重要作用,成为AI时代伪造检测的重要工具。

基于机器视觉的端到端AI检测解决方案,专为AI篡改设计

源代码

https://www.gitpp.com/detech/projects06016058801

这是一个市场巨大的项目,通过技术研发、产品化部署、市场推广和生态建设,该项目有望在新闻、司法、金融等领域发挥重要作用,成为AI时代伪造检测的重要工具。

本篇文章来源于微信公众号: GitHubFun网站

暂无评论内容